这里使用Ollama部署Qwen3模型进行推理场景的性能实测,比较3080 20G和3090 24G的差异到底多大?

RTX 3080 20G显卡是基于3080 10G魔改的卡,目前市面比较多得被用于小规模参数的大语言模型推理场景,被认为是性价比比3090还高的推理显卡。

因为其在二手交易市场的价格差不多是3090的一半左右,算力租赁市场的几个也只有3090的70%,而其算力和显存都是3090的80%多。

之前测试过3090 24G和4090 24G两张显卡在大模型推理场景的性能差异,参考:

Ollama大模型推理场景下3090和4090性能实测

3080 20G和3090 24G的显卡参数对比

| RTX 3080 20G | RTX 3090 24G | |

|---|---|---|

| 架构 | Ampere | Ampere |

| CUDA核心数 | 8704 | 10496 |

| 显存容量 | 20 GB GDDR6X | 24 GB GDDR6X |

| 显存带宽 | 760 GB/s | 936 GB/s |

| TDP功耗 | 320W | 350W |

| FP32 算力 | 29.8 TFLOPS | 35.6 TFLOPS |

| Tensor FP16 算力 | 119 TFLOPS | 142 TFLOPS |

对比显卡参数,很有意思的是,3080 20G在核心数量、显存、带宽、算力方面基本都是3090 24G的83%左右。

Ollama大模型推理测试

大模型选择

这里选择 Qwen3的模型进行测试,考虑到3080显存只有20GB,分别选择一个FP16精度和一个Q4_K_M量化后的大模型进行测试:

| 模型 | 精度 | 大小 |

|---|---|---|

| qwen3:8b | fp16 | 16 GB |

| qwen3:14b | q4_K_M | 9.3 GB |

借助DeepSeek 生成测试脚本,使用复杂度近似的8个prompts;MAX_TOKENS配置256,让每次请求需要一定的生成时长便于采样显卡的使用指标,减少波动;同时需要模型预热,消除第一次推理响应延时过大的问题。

AI算力租赁平台有 3080 20G 的不多,这里只找到了 AutoDL 和 晨涧云 两家,创建3080 20G和3090 24G两种显卡的Ollama容器实例,启动后访问Open WebUI 选择模型:

然后就可以执行推理性能测试脚本,查看输出结果。

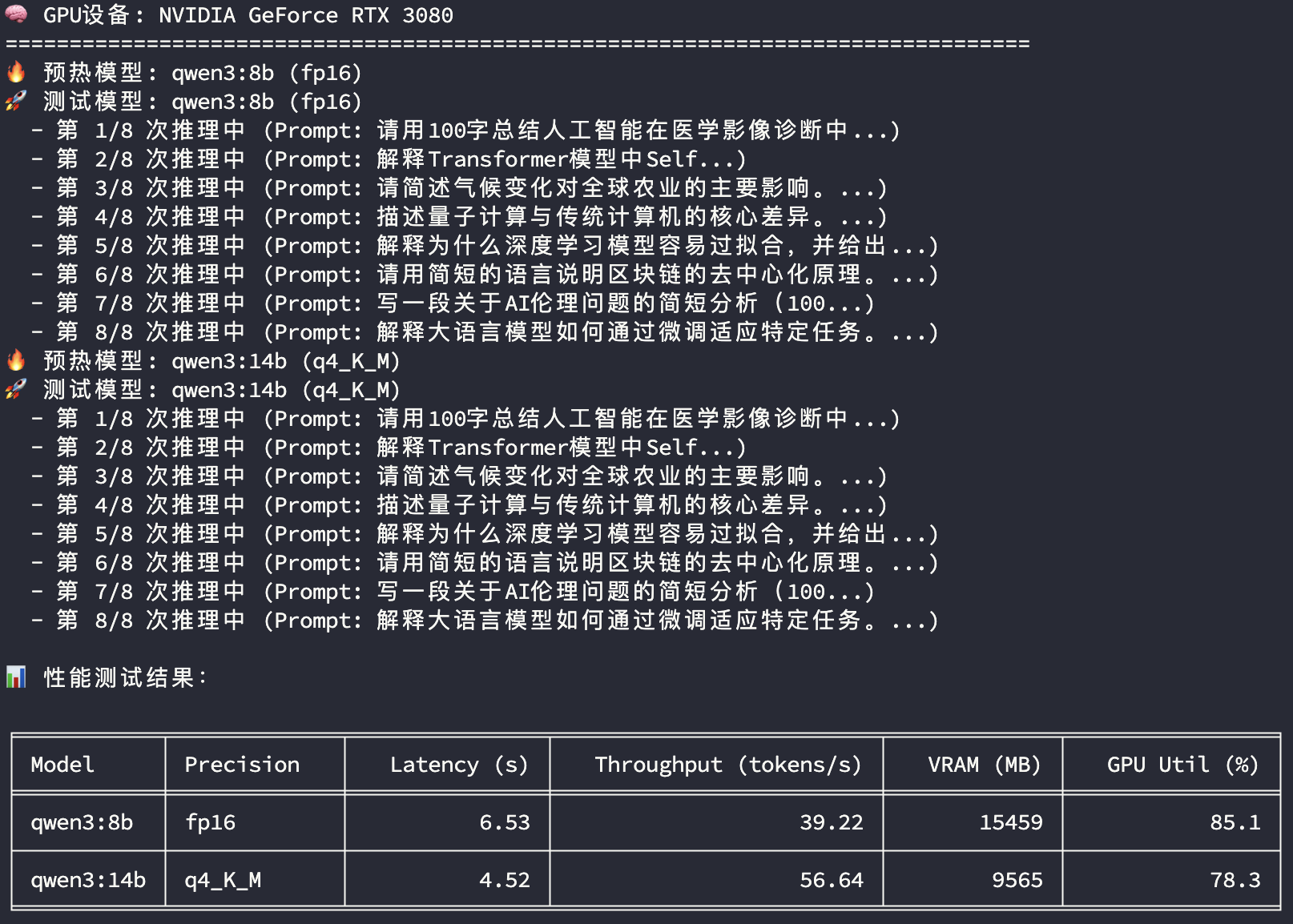

3080 20G推理性能

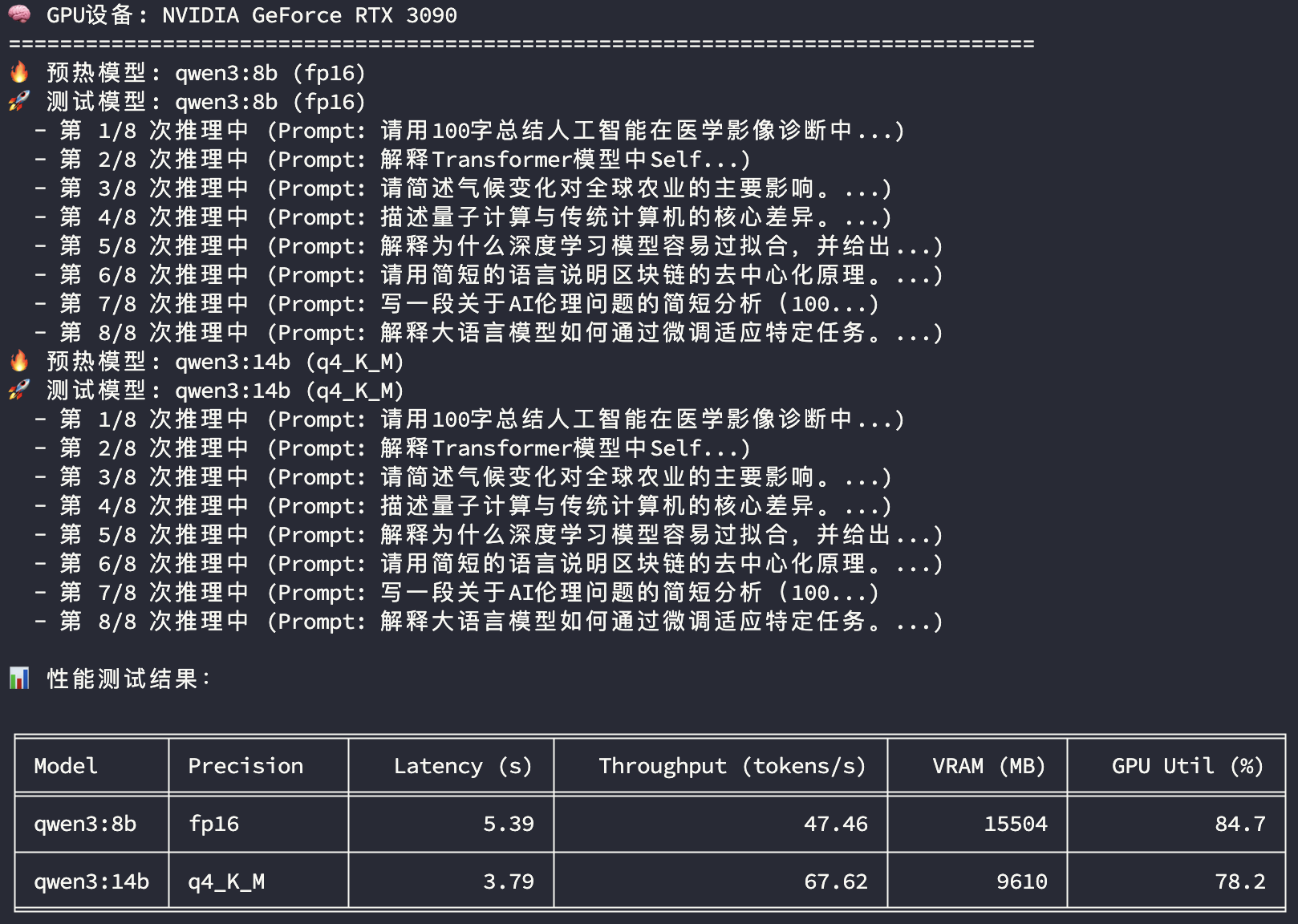

3090 24G推理性能

测试结果解释

-

Latency (s):多次推理平均响应时长

-

Throughput (tokens/s):多次推理平均Token生成速度

-

VRAM (MB):多次推理平均显存使用量

-

GPU Util (%):多次推理平均GPU使用率

3080 20G显卡和3090 24G显卡在两个模型推理过程中的显存使用和GPU使用率都比较接近,主要比较平均响应时长及平均Token生成速度两个指标:

| qwen3:8b fp16 | qwen3:14b q4_K_M | ||

|---|---|---|---|

| 响应时长(s) | 3080 | 6.53 | 4.52 |

| 响应时长(s) | 3090 | 5.39 | 3.79 |

| 响应时长(s) | 差异 | 121.2% | 119.3% |

| Token生成速度(tokens/s) | 3080 | 39.22 | 56.64 |

| Token生成速度(tokens/s) | 3090 | 47.46 | 67.62 |

| Token生成速度(tokens/s) | 差异 | 82.6% | 83.8% |

FP16精度和Q4_K_M量化模型的推理性能 3080 20G 都是 3090 24G 的83%左右,和显卡参数算力的差异基本一致。

相比二手市场3080 20G价格只有3090的一般多点,GPU算力租赁市场3080 20G的价格也只有3090的70%,所以在性价比上3080 20G还是有其优势的,前提是3080 20G的显存能装得下推理的模型。