神经风格迁移算法学作画,人类会在艺术领域败给人工智能吗?

作者:佚名 2017-08-30 20:10:56

人工智能

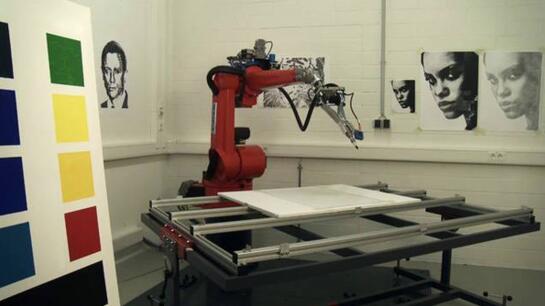

算法 随着人工智能越来越全能,TA们似乎已经能接替我们完成一切工作,或许未来真的像某位大佬说的一样,人类只负责研究艺术和哲学。

随着人工智能越来越全能,TA们似乎已经能接替我们完成一切工作,或许未来真的像某位大佬说的一样,人类只负责研究艺术和哲学。

不过目前看来,艺术这块阵地也快要失守了。

用过Prisma的应该都知道,把照片变成名画风格如今只是动动手指的事情。事实上,只要有一两张样本,神经网络可以迅速的学会各种风格,这种技术被称为“神经风格迁移”。

如何实现神经风格迁移?

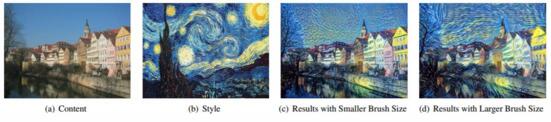

卷积神经网络将图像分割为“内容”和“风格”,在抓取时,高层神经网络抓取了图片的风格,比如色彩和排列。而底层神经网络抓取的则是图像的内容,也就是图像的细节。

这只是神经风格迁移的***步,在抓取了风格之后,还要将风格迭代到需要改变的图片上。

风格迭代通常有两种方式,一种基于图片,直接更新迭代图片像素,最终实现风格的迁移。很多算法会在过程中计算***均值差,测量风格图像和内容图像之间的差异。让两种图像“对齐”,从而减少图像迭代时造成的损失和误差。

另一种则是基于模型迭代的,当需要用某一种风格迭代大量图像时,可以训练前馈网络,使用梯度下降,通过迭代式地更新模型来优化网络模型。

神经风格迁移应用,不仅仅是画作

如果你认为神经风格迁移只是一个升级版的photoshop滤镜,那就大错特错了,很多案例表明,这一技术正在被应用于越来越多的领域之上。

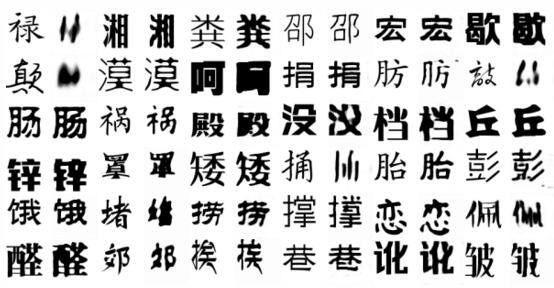

比如Flipboard软件工程师曾经发布过一个将神经风格迁移应用在汉字字体上的项目。

提供2000个左右的样本字体,让神经网络识别出偏旁部件和笔触风格的区别,最终就能实现出字体之间的转化。

又比如在暮光之城女主角克里斯汀·斯图尔特拍摄的电影《Come swim》中,也利用了神经风格迁移技术将印象派绘画风格和电影画面相融合。就此,克里斯汀还写了一篇题为“运用神经风格转移实现印象派风格之在电影“Come Swim”中的应用”的论文。

如上图一样,从画作中提取风格,再通过算法迭代渲染到画面之上。不过在论文中基本没有提到成本,尤其是时间成本问题。《Come swim》中的情节是一半现实(未经处理过的画面)和一半梦境(经由神经风格迁移处理过的画面)。从拍摄上来说自然是直接渲染更加方便,如果是完全的动画电影,这种先拍摄再渲染的方式是否比直接电脑绘制更有性价比还值得商榷。

神经风格迁移真的能“替代”艺术吗?

其实说了这么多,多少有点耸人听闻的嫌疑。从艺术的角度来讲,神经网络迁移只不过是另一种“印刷术”,过去的印刷术是在复制图像,而神经网络迁移是在复制风格。

而且神经网络迁移是没有“创作”能力的,如果不给TA需迭代的图像内容,TA只能产出一些无意义的、混乱的像素点。虽然目前有人利用图像语义布局技术让AI创造出全新的画面,但对于AI来说,这只是一种模仿,在创造时没有付诸情感,可能和我们定义中的艺术还有着不小的差距。

可神经风格迁移能做到的,却是在艺术商业化过程中为人们节约大量的时间。

比如在字体项目中,艺术创作者只需创造少量字的字体,机器则负责完成剩下的工作。又比如以《Cool swim》为代表的影视后期工作,只需要几张画作确立风格,就能完成对整部电影的渲染。

目前看来,神经风格迁移最适合应用在动画产业上。比如新海诚的作品,就是出了名的和实景高度相似,色彩风格显著。之前还有照片后期产品推出过新海诚风格的滤镜,和风景照结合,和动画中的画面非常相似。而神经网络迁移,则可以更好的完成这项工作。包括对动画原稿的上色等等,都能极大的提高产业工作效率。

这也给艺术创作提出了一个全新的问题,我们是否应该为“风格”设立所有权?毕竟利用神经网络迁移,人人都可以以假乱真的模仿梵高。如果一副画作由我原创,却经由他人风格迭代处理,那这幅画的作者究竟应该是我还是别人,又或者该属于算法的开发者?在模仿的成本极低时,又该如何为模仿和抄袭划分界限?

当然,这些都是后话。科技的发展,除了为人类生活带来便利之外,还在不断刷新着我们对各种事物的定义。像是一百年前我们认为艺术只能诞生于画布和颜料中,而如今数位板、Photoshop都是创造艺术的工具。人工智能不会从人类手中夺走创作权,更不会“消灭”艺术,只会将这项美妙的事业带上更高的境界。